type

Post

status

Published

date

Apr 19, 2026

slug

la

summary

从工程和计算的角度看,线性代数并不是“矩阵算术”,而是一套用来描述、组织和求解复杂多变量系统的语言。它是现代科技文明的底层基础之一。没有线性代数,就不会有现代图形渲染、通信系统、推荐算法、深度学习,也不会有今天几乎所有依赖海量数据处理的技术体系。

tags

思考

category

心情随笔

icon

password

Description

如果只看传统教材,我们会觉得线性代数就是一堆毫无意义的数字表格:每天的任务无非是算行列式、求逆矩阵、把矩阵化成行阶梯形。

但这些其实根本不是线性代数真正的面貌,充其量只能叫“矩阵算术”,而且还是上个世纪为了培养人工手算能力而设计出来的一套矩阵算术。

真正的线性代数,是现代科技文明的绝对底座。没有线性代数,就不会有今天的 3D 游戏,不会有现代智能手机,不会有现代通信网络,更不会有如今大热的深度学习和人工智能。现代社会里,只要涉及海量数据处理,底层几乎都离不开线性代数。

所以,回到最核心的问题:线性代数到底是为了解决什么问题而被发明出来的?

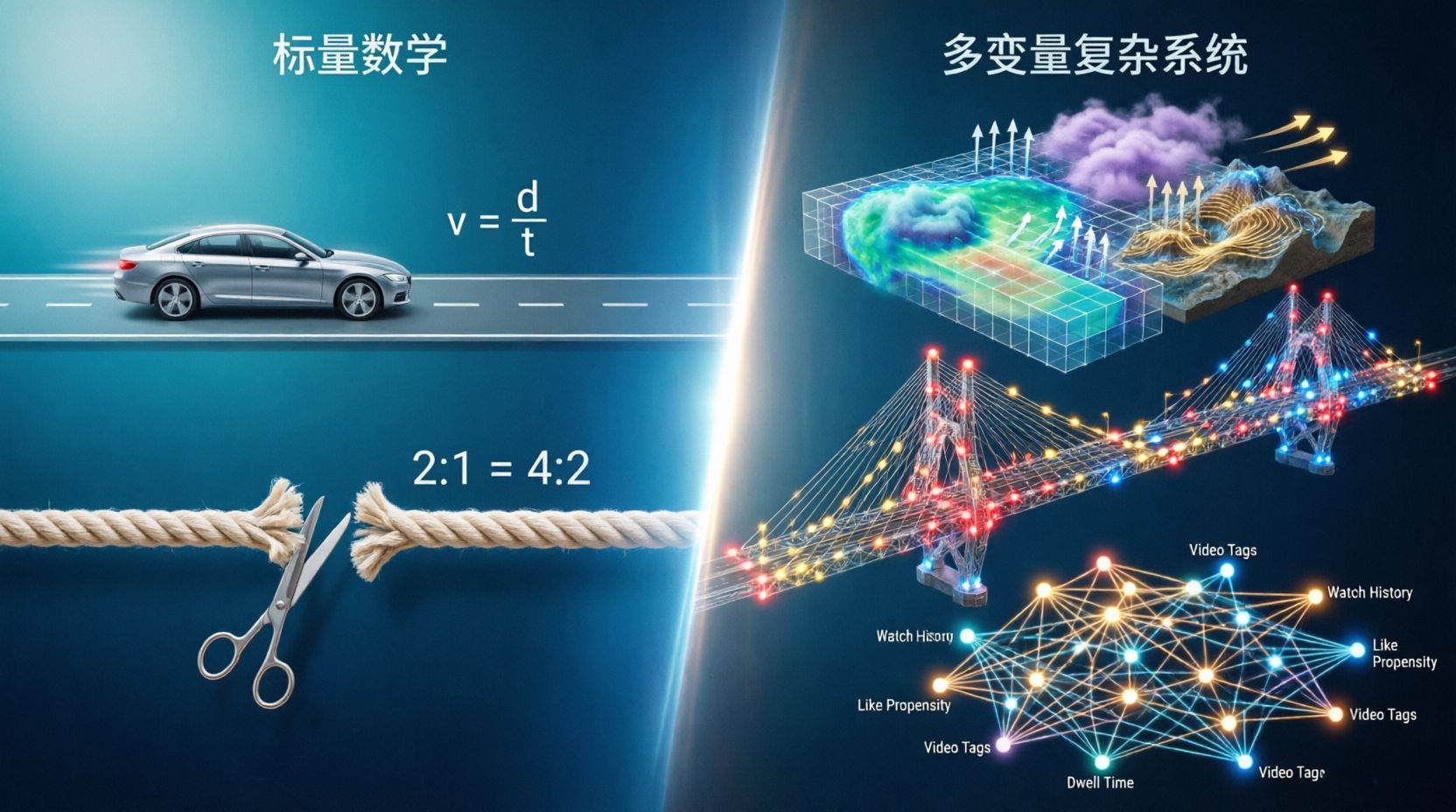

一、人类擅长单变量,但现实世界是多变量的

人类的大脑结构其实非常“单线程”。我们天然更擅长处理单变量问题。

中学阶段学的大部分数学,本质上都是单变量数学:

一个未知数 (x),列一个方程,解出一个答案。

比如一辆车以某个速度行驶,求多少小时后到达;比如一段绳子剪成两段,求比例是多少。这些问题都属于标量层面的数学。

但真实的物理世界和工程世界完全不是这样。

现实世界里的系统,从来不只有一个变量。比如:

- 气象局做天气预报,要同时考虑温度、湿度、气压、风向、地形等成千上万个互相影响的变量;

- 建造一座跨海大桥,要计算几万个钢梁交接点在不同风速和车辆载重情况下的形变;

- 刷短视频时,后台算法要综合考虑观看历史、停留时间、点赞倾向、视频标签等几百个特征,来决定下一个给推什么。

当变量成百上千,甚至达到几千万个的时候,再用中学那种孤立的代数方程组去处理,不仅纸面写不下,人类的思维本身也会彻底崩溃。

于是我们就需要一种全新的语言,去描述和处理这种高维度、多变量、并发耦合的关系。

线性代数,就是在这样的需求下诞生的。

二、线性代数的第一个核心使命:把复杂系统打包

线性代数提供了一种极其强大的“打包方式”。

无论的系统里有 3 个变量,还是 300 万个变量,线性代数都可以把它们打包成一个简洁的方程:

在这个表达中:

- (x) 不再是一个单一数字,而是一个包含所有未知数的状态向量;

- (A) 是一个包含所有相互作用关系的规则矩阵;

- (b) 则是系统在给定约束下的输出结果。

这就是线性代数诞生的第一个核心使命:

让我们能够用高度简洁的符号体系,去操作和求解那些已经超越三维直觉的复杂系统。

一旦认清了这个使命,就会明白:现在学的很多内容之所以让痛苦,并不是因为线性代数本身没有意义,而是因为很多教材把整体和局部的关系讲反了。

三、为什么很多人学线性代数会痛苦?

问题往往不在学生,而在教学顺序。

传统教材最大的缺陷之一,就是一上来就教算行列式、算逆序数、学矩阵乘法,规定一堆死板的同行同列运算规则,却完全剥夺了这门课最关键的东西:几何直觉。

这就像教人开车,一上来不让摸方向盘,不让看路,而是先把关在黑屋子里,让背诵发动机的气缸运动原理。

当然会觉得枯燥,也当然很难真正理解。

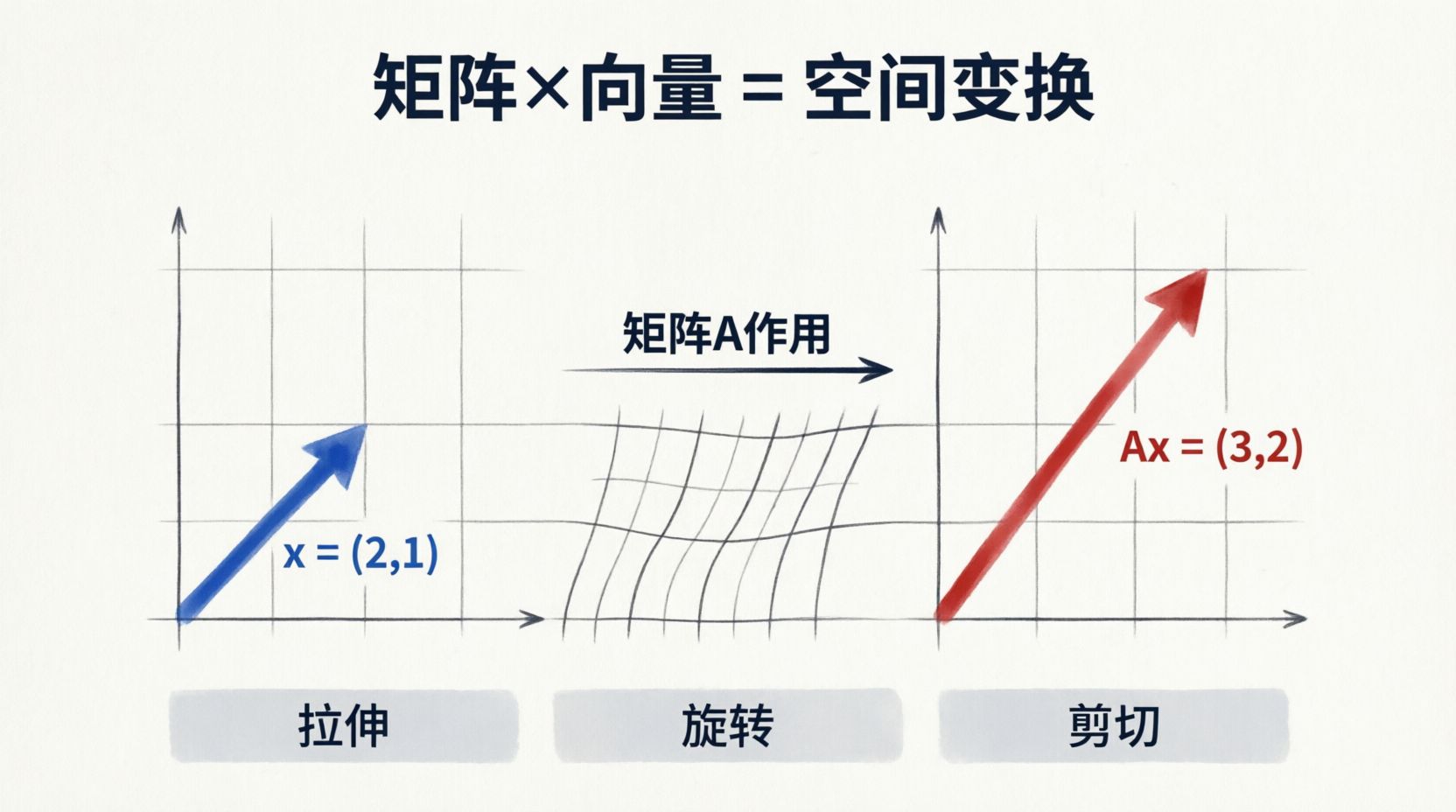

要想真正学懂线性代数,必须建立几何直觉。

这是很多人在踩过无数坑、写过无数报错代码之后才真正明白的事。

从这个角度看课本时,要开始强迫自己转换视角:

- 不要把矩阵看成数字表格;

- 不要把向量看成一列数字。

要知道:

- 向量是空间中的一个坐标点,或者一条有向线段,它代表了事物在当前空间中的一个状态;

- 矩阵是对这个空间施加操作的动作,它代表了一种变换规则。

当一个矩阵乘以一个向量,也就是 (Ax) 时,它的几何意义不是“做了一堆算术”,而是:

矩阵 (A) 对向量 (x) 施加了一种空间变换。

这种变换可能是拉伸,可能是旋转,也可能是剪切。

四、“线性”到底是什么意思?

线性代数里的“线性”两个字,并不是随便起的名字,而是对空间变换提出了两个极严格的要求:

第一,原点必须保持不动;

第二,所有直线在变换后依然是直线,平行线依然平行。

也就是说,空间不能被随意扭成麻花。

只要真正理解了这个几何限制,很多原本需要死记硬背的规则就会一下子变得清晰。

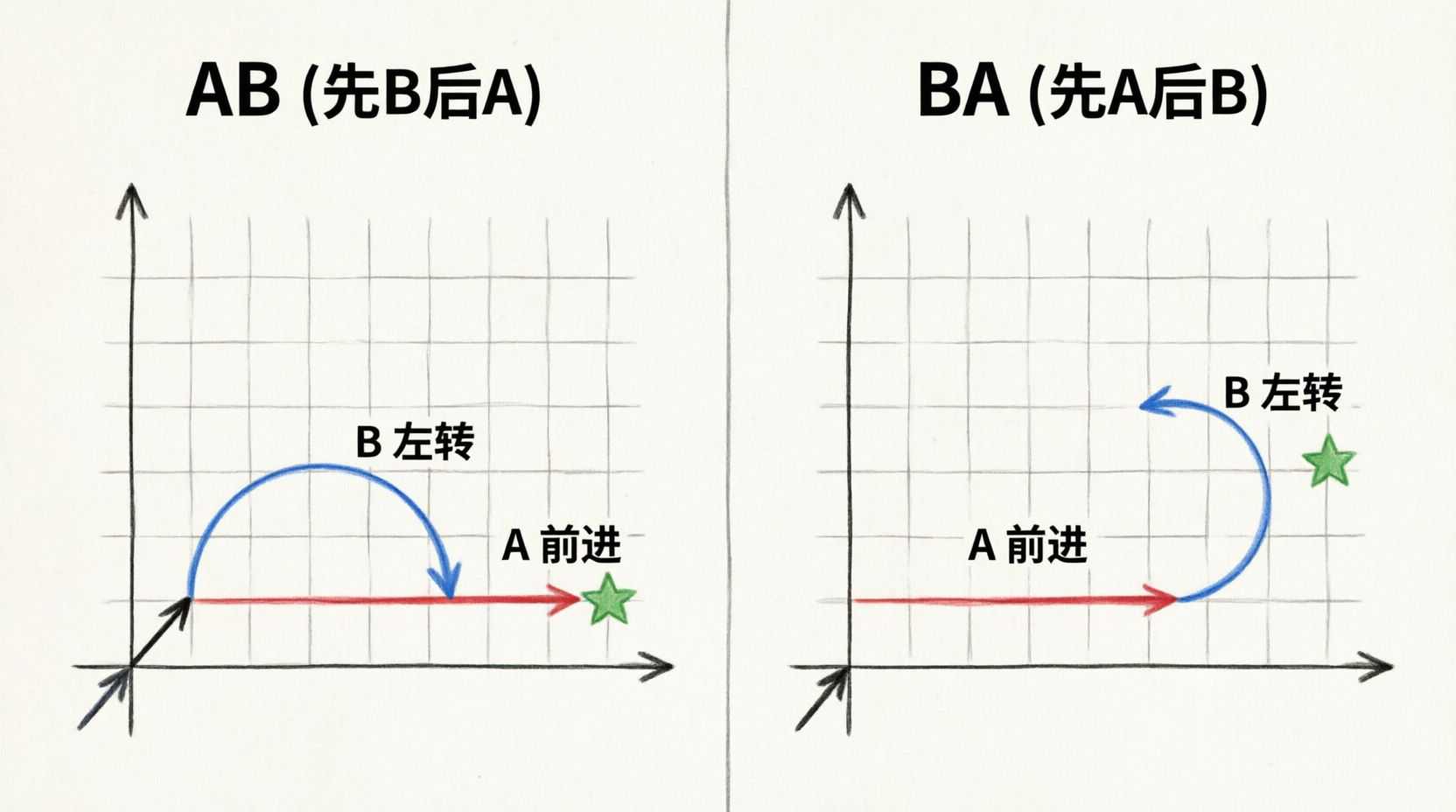

比如矩阵乘法。

两个矩阵相乘 (AB) 到底是什么意思?

它根本不是什么复杂的数字游戏。它表示的是:先对空间施加 (B) 变换,再施加 (A) 变换。

这样一来,为什么 (AB \neq BA) 就完全不神秘了。

先向左转再向前走,和先向前走再向左转,最后到达的位置当然不一样。物理空间中的动作顺序不能随意交换,矩阵乘法当然也不能交换。

五、建立几何直觉后,很多概念会豁然开朗

一旦真正建立起这种几何视角,就会发现很多原本枯燥的概念其实都很直观。

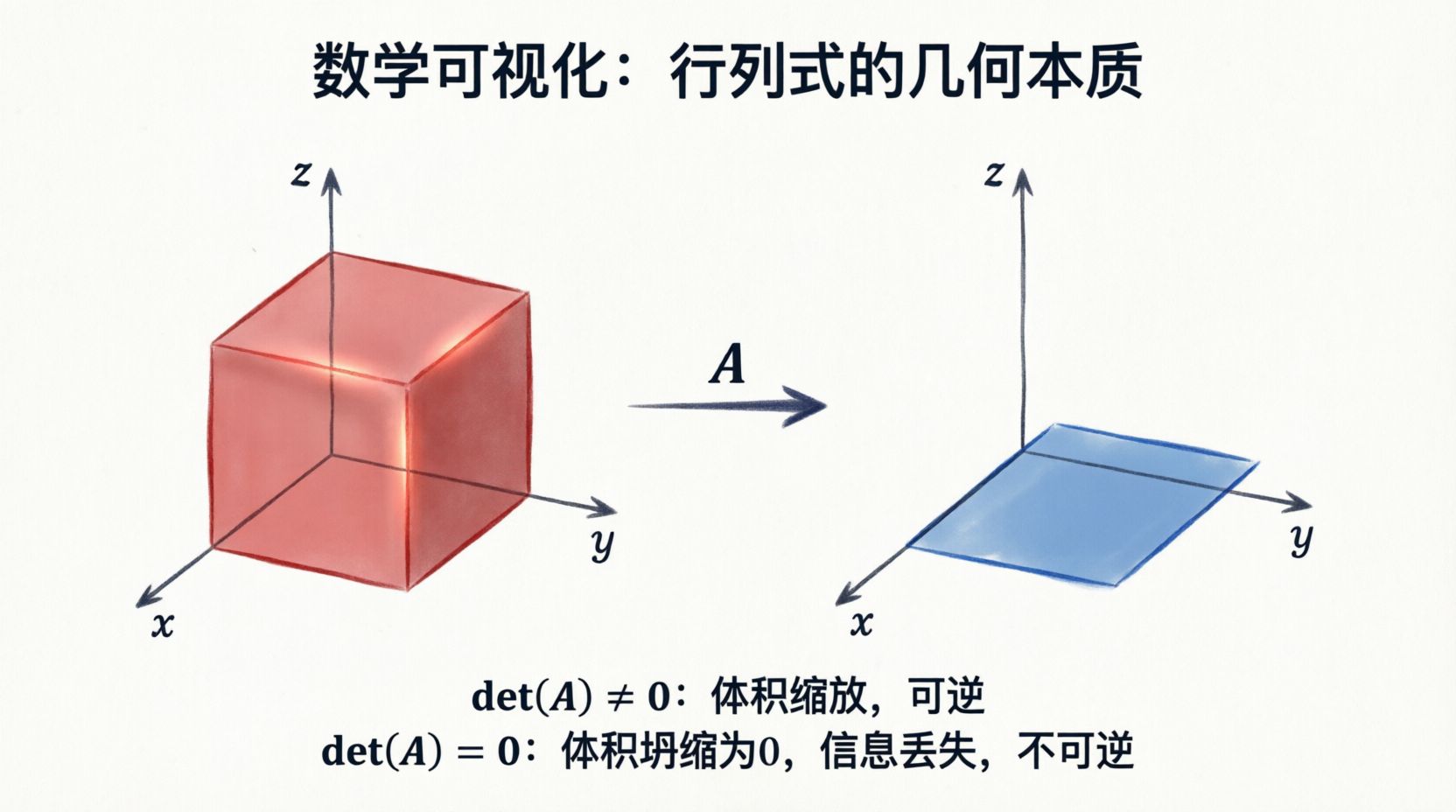

1. 行列式的本质是什么?

行列式的本质,就是空间变换后体积的缩放比例。

如果一个矩阵的行列式等于 0,意味着这个变换把原本三维的立体空间压扁成了二维平面,甚至压成了一条线。体积变成了 0,也就意味着信息发生了丢失。

既然空间被压扁,信息已经丢失,那么这个变换当然不可逆。

这就解释了为什么行列式为 0 的矩阵没有逆矩阵。

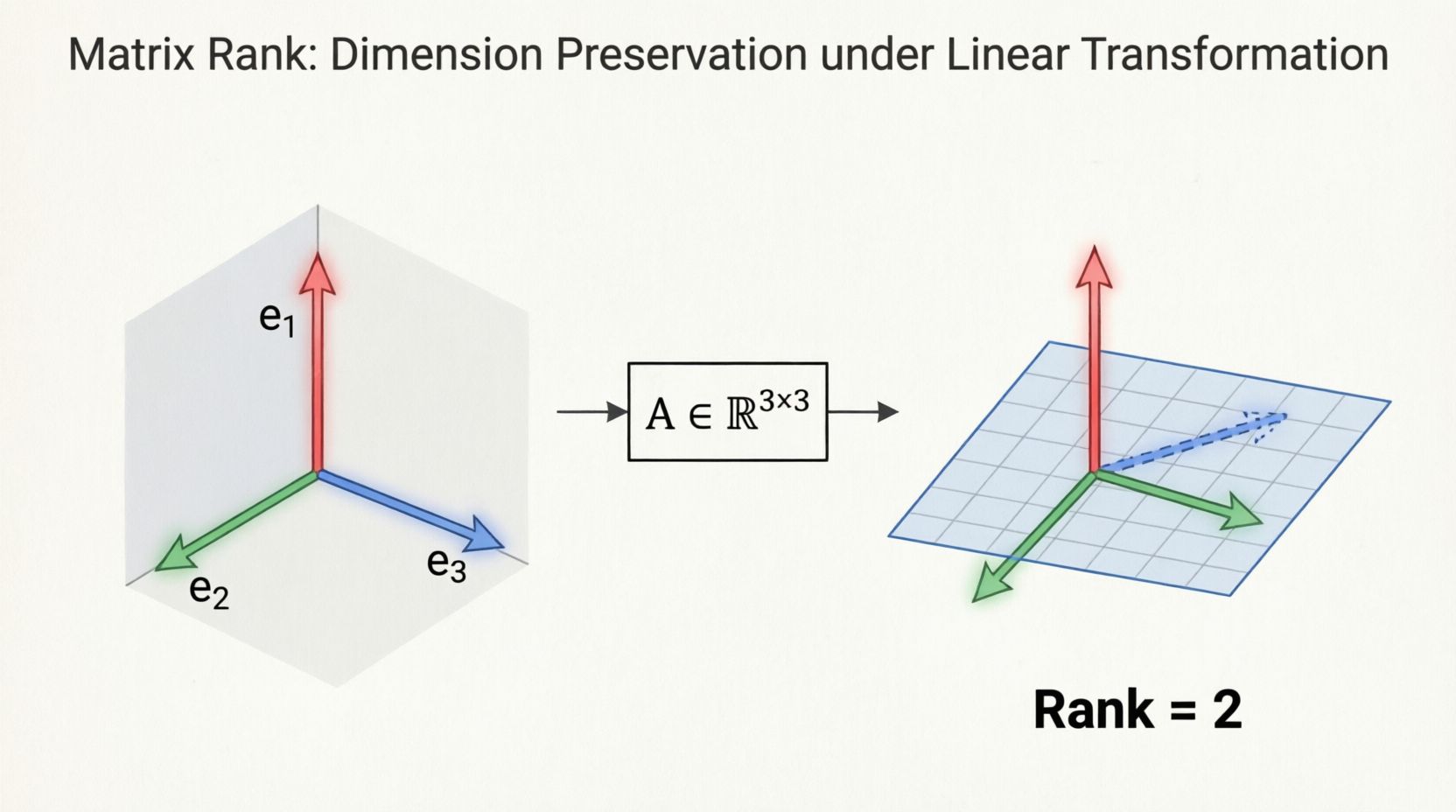

2. 矩阵的秩是什么?

矩阵的秩,本质上就是变换后空间保留下来的真实维度。

它告诉:经过这个矩阵作用以后,原本空间中的有效独立方向还剩下多少。

这类概念如果只从算术规则讲,很容易背了又忘;但一旦放到空间变换里理解,就会自然很多。

六、现实中的第一个硬核场景:计算机图形学与游戏引擎

建立几何直觉只是第一步。接下来更重要的是:必须知道线性代数在现实中到底怎么用。只有知道应用场景,学习时才有底气,才知道哪些内容只是应试工具,哪些内容是真正的饭碗。

先说第一个非常硬核的真实场景:计算机图形学与游戏引擎开发。

平时玩的三维游戏,无论是人物、建筑还是风景,在计算机底层根本不是“画面”,而是一大堆三维坐标点。一个高精度的人物模型,可能包含上百万个顶点。

当角色跑动、转身、跳跃、挥舞武器时,计算机怎么知道这上百万个顶点应该出现在屏幕的什么位置?光照应该如何反射?

这整个过程,底层几乎全是线性代数。

游戏引擎会把这些顶点打包成巨大的矩阵。当玩家推动摇杆,让角色手里的武器挥舞起来时,底层代码实际上是在生成一系列旋转矩阵和平移矩阵,然后用这些矩阵去乘以模型上的顶点矩阵。在一瞬间,几千万次乘法运算并发执行,所有顶点便在三维空间中完成了旋转与位移。

接着,系统还要把三维世界投影到二维显示器上:

- 玩家视角的转动,本质上是在乘一个视图矩阵;

- 把三维物体“拍扁”到屏幕上,本质上是在乘一个透视投影矩阵。

这里还有一个很多教材不太强调、但工程中极其关键的概念:齐次坐标。

在线性代数的严格定义里,线性变换必须保证原点不动。这意味着普通的 (3 \times 3) 矩阵可以表示旋转和缩放,却不能直接表示平移,因为平移会把原点挪走。

但游戏里人物显然是要向前走的。于是工程上采用了一个极其优美的办法:

把三维空间中的点提升到四维空间,引入一个额外的 (w) 分量,然后用 (4 \times 4) 矩阵统一表示旋转、缩放和平移。这样,在四维空间中做特定变换,再投影回三维空间,平移操作就被自然地纳入了矩阵体系。

这就是为什么在图形学教材里经常看到 (4 \times 4) 矩阵处理三维坐标。

电脑里那张昂贵的显卡,其设计初衷之一,就是高速执行这种大规模并发矩阵乘法。

从图形渲染到后来的 AI,本质上都离不开海量矩阵计算。

如果没有线性代数这套描述空间变换的理论,我们根本不可能在屏幕上看到逼真的三维世界,更别说 VR 之类的技术形态了。

七、第二个场景:深度学习与大模型

再来看第二个当下最火热的场景:深度学习与大模型。

外界谈论生成式 AI 时,动不动就是几百亿、上千亿参数,很多人会觉得这很神秘,仿佛 AI 真的“涌现出了灵魂”。

但对真正坐在电脑前写代码、调模型的人来说,眼前的东西其实非常朴素:漫山遍野的矩阵和张量。

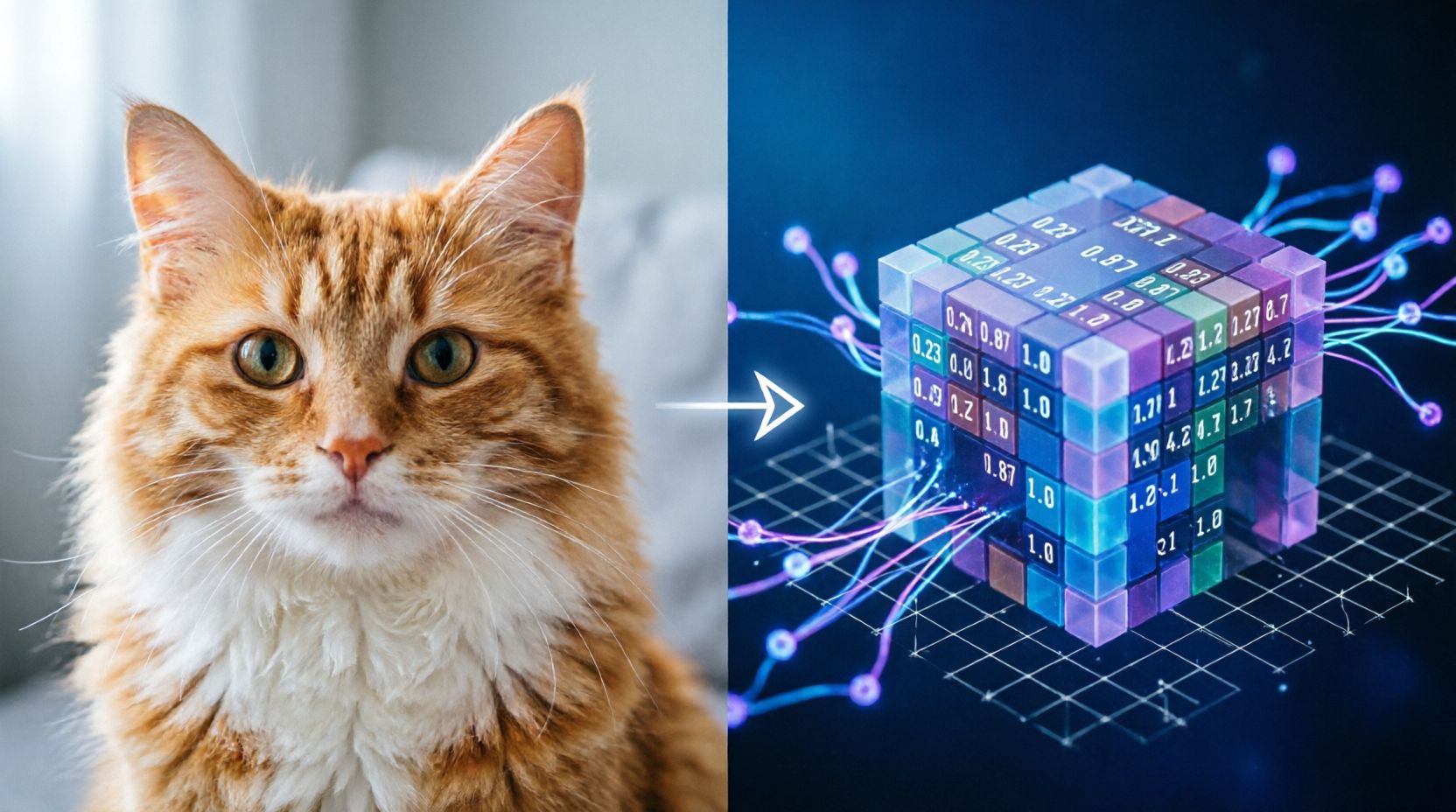

深度学习的本质,就是通过多层人工神经网络去拟合极其复杂的数据分布。

一幅猫的图像输入神经网络后,在计算机看来,它不是毛茸茸的动物,而是一个包含几万个像素值的三维张量,也就是高维矩阵。

神经网络每一层在做什么?

最基础、最核心的操作就是:

这里:

- (x) 是上一层传来的数据向量;

- (W) 是这一层学习到的权重矩阵;

- (b) 是偏置向量。

可以把神经网络的特征提取过程,理解为在高维线性空间里不断地对数据做投影和变换。

我们通过一层层矩阵乘法,再叠加非线性激活函数,把原本杂乱无章、高度纠缠的像素数据,映射到一个更高维的抽象空间中。到了那个空间里,猫和狗的数据点可能就被清晰地分到了不同区域。

那些所谓“千亿参数”,本质上就是无数个巨大权重矩阵里的数字。

训练 AI,其实就是用梯度下降不断微调这些矩阵中的数值,让它们最终把输入数据映射成我们期望的输出。

在工程实践中,很多时候最可怕的并不是业务逻辑写错,而是矩阵维度对不上。

辛辛苦苦搭好一个 Transformer,满怀期待地点运行,结果直接报出形状不匹配的错误。然后只能拿纸重新算:这个张量经过自注意力里的 Q、K、V 变换后形状是多少?拼接之后再乘输出矩阵,维度还对不对?

这就是深度学习工程师的日常。

所以,在线性代数里真正重要的,绝不是会不会手算一些小矩阵,而是能不能理解这些高维变换背后的结构。

八、最容易被讲“死”的概念:特征值与特征向量

在线性代数里,最让学生痛苦、也是很多老师最容易讲得照本宣科的概念之一,就是特征值与特征向量。

传统教材的讲法往往是:

给一个方阵 (A),让列出特征方程,解出几个根,叫特征值;再带回去解齐次线性方程组,求出一组非零向量,叫特征向量。

全篇都在算,但根本不告诉这到底在干什么。

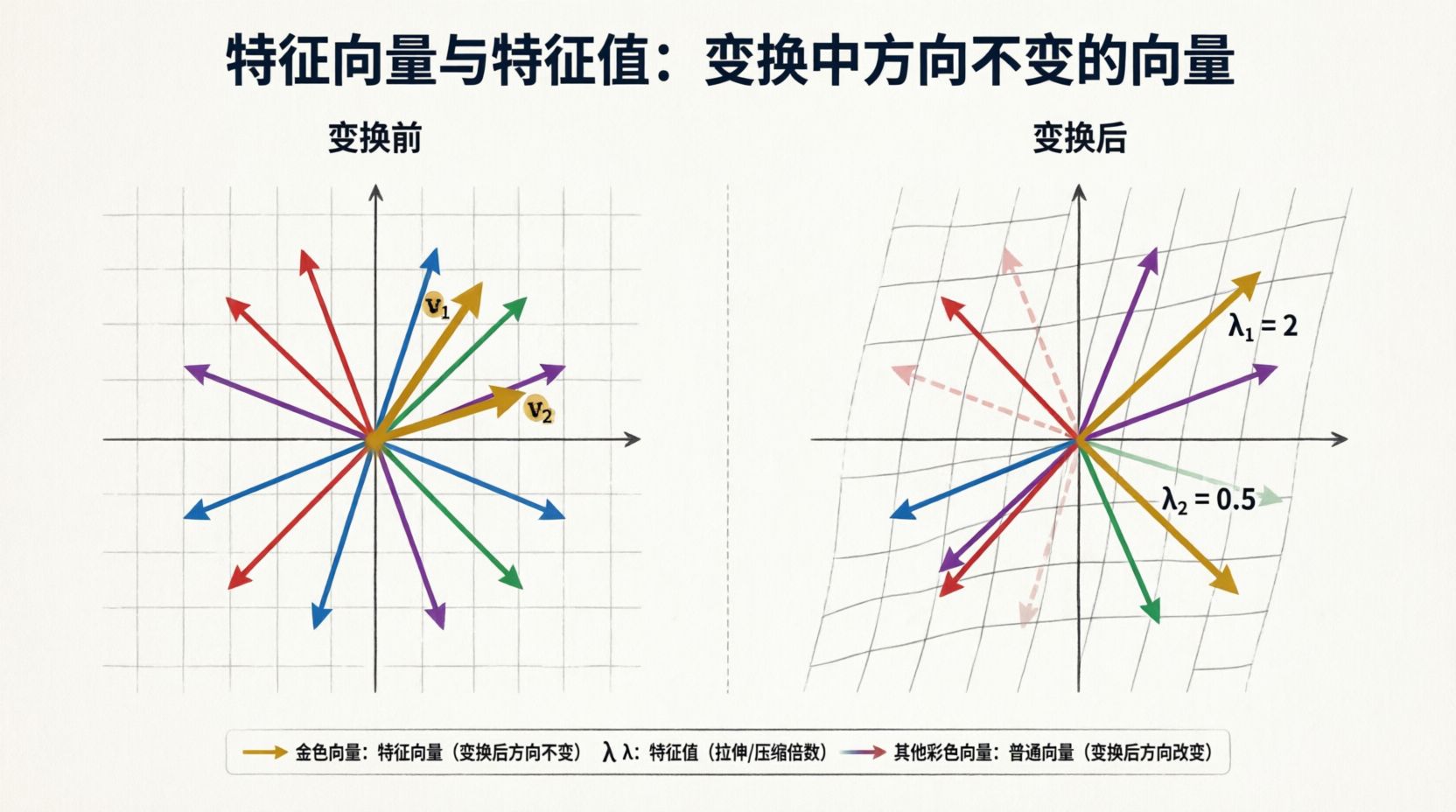

其实,特征值和特征向量是线性代数里最深刻、最接近本质的思想之一。

前面说过,矩阵是对空间的一种变换动作。

当一个矩阵对空间进行拉伸、旋转、扭曲时,大多数向量在变换之后都会改变方向,被拉到别的地方去。

但在某些方阵所代表的特定变换中,总会存在一些非常特殊的向量:

它们在经历变换后,方向居然完全不变,只是长度被拉长或压缩了。

这些在变换中保持方向不变的特殊向量,就是特征向量;

它们对应的拉伸或压缩倍数,就是特征值。

九、特征值在现实中的用处,远超想象

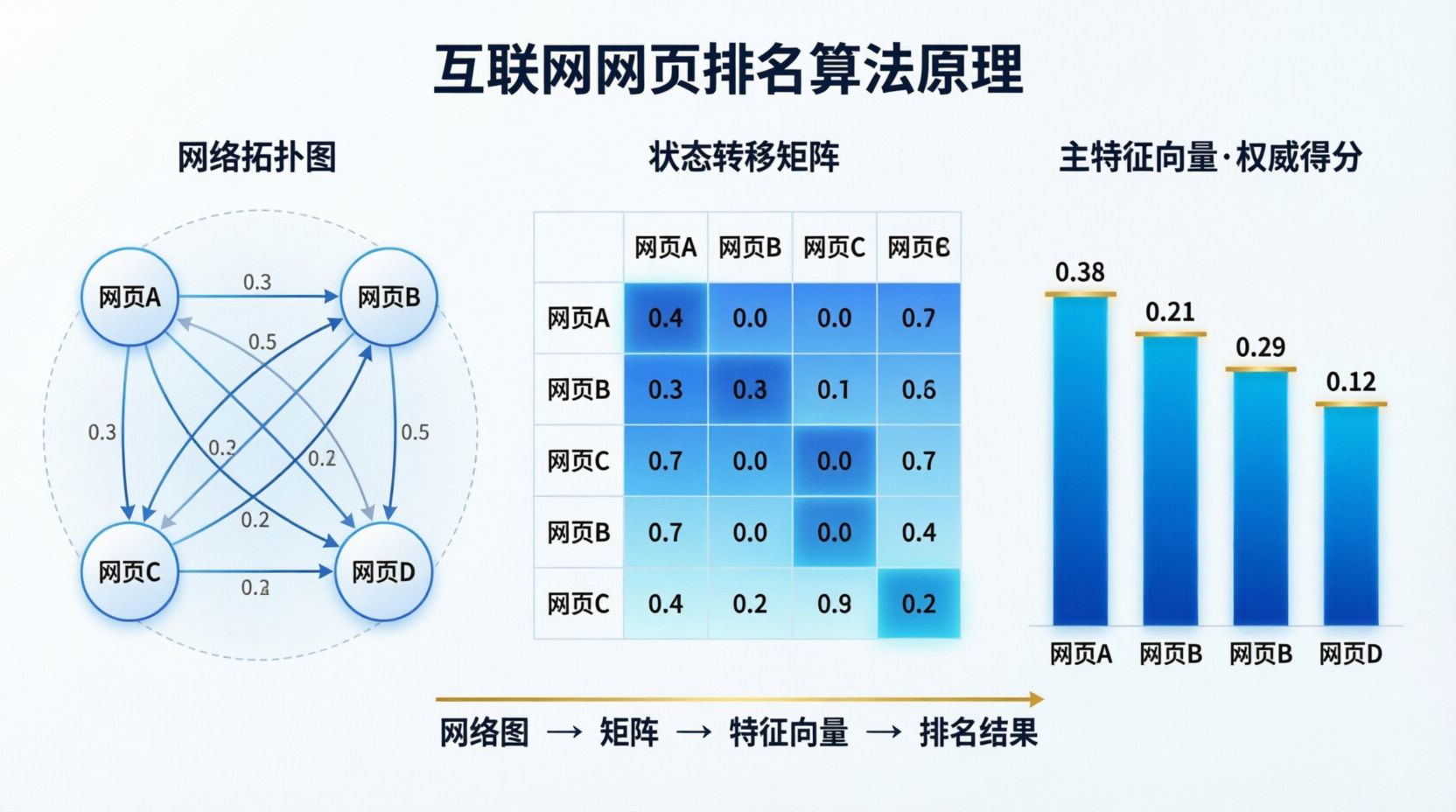

1. PageRank:搜索引擎的核心思想

Google 当年为什么能打败竞争对手,成为互联网霸主?

关键技术之一,就是 PageRank。

互联网中的网页可以被抽象成节点,网页之间的超链接可以被抽象成有向边。于是,整个互联网的跳转关系就可以压缩成一个巨大的状态转移矩阵。矩阵里的数字表示用户从网页 A 跳转到网页 B 的概率。

这时,Google 并不是简单统计点击量,而是直接去求这个超级大矩阵的主特征向量。

那个对应稳定分布的特征向量中的数值,正是每个网页在系统达到动态平衡后的最终“权威得分”。

换句话说,全网网页排名的计算,本质上就是在求一个超大规模矩阵的主特征向量。

这就是线性代数在互联网世界里威力巨大的体现。

2. 结构工程:共振与灾难

再看一个结构工程中的例子。

一阵复杂的风吹过悬索桥,风的作用力可以分解成无数个不同频率和方向的向量;桥梁本身的刚度和结构耦合关系,可以写成一个巨大的刚度矩阵。

如果去求这个刚度矩阵的特征值和特征向量,得到的就是桥梁的固有振动模式和共振频率。

一旦外界激励频率撞上这些固有频率,就可能引发灾难性的共振。

在工程师眼里,特征值不是考试题,而是可能关系到生命安全的参数。

特征值算错,是真的会出事的。

十、皇冠上的明珠:奇异值分解 SVD

在线性代数中,还有一项真正的“皇冠明珠”级工具:奇异值分解(SVD)。

很多考试可能不会深入讲它,但在数据科学和推荐系统里,SVD 是真正的镇山之宝。

现实中的很多矩阵根本不是方阵。比如电商系统中的用户—商品矩阵,可能有几亿个用户、几千万件商品,而且这个矩阵还极其稀疏,因为大多数人一辈子也买不了多少东西。

如果想直接分析这样一个巨型矩阵,几乎不现实。

SVD 的伟大之处在于,它证明了:任何一个复杂矩阵,都可以被拆成三个更简单矩阵的乘积。这相当于把一个复杂系统分解成:

- 一个表示原空间正交变换的矩阵;

- 一个表示拉伸强度的对角矩阵;

- 一个表示目标空间正交变换的矩阵。

放在推荐系统里,这意味着可以把那个巨大的用户—商品矩阵,压缩成“用户特征矩阵”和“商品特征矩阵”。原来几千万个商品,不再以表层标签存在,而是被压缩成少数几个潜在特征维度。

于是,系统就能通过比较在这些核心特征上的位置,更准确地猜出下一步想买什么。

今天很多推荐流、协同过滤方法,其思想源头都和 SVD、矩阵分解密切相关。

十一、为什么很多学生会觉得线性代数学不懂?

这确实不能全怪学生。

它反映的是一种基础课教学模式的结构性问题。

传统教材体系诞生于一个计算设备极度匮乏的年代。在那个时代,手算能力是第一位的,国家需要大量能靠草稿纸解方程组的技术员,于是教材花了大量篇幅去教:

- 克莱姆法则;

- 高斯消元;

- 矩阵初等变换;

- 配方法化简二次型。

所有例题里的数字往往都是 1、2、3 这类小整数,因为方便手算。

但今天,时代已经变了。

没有哪个工程师会在草稿纸上手算一个 (4 \times 4) 矩阵的逆。我们在电脑上敲一行代码,数值库瞬间就能给出结果。现实世界里的数据也几乎不可能是整齐的小整数,通常都是带着大量小数位的浮点数。

在这种背景下,现代人学习线性代数,最不应该浪费精力的,就是繁琐的算术操作。

真正需要掌握的是:

- 计算思维;

- 系统思维;

- 空间思维;

- 对结构与变换的理解。

我们需要知道什么是列空间,它代表系统中有效数据的生成范围;

我们需要知道什么是零空间,它代表系统中被隐藏和抵消掉的内部矛盾;

我们还需要知道如何把高维噪声数据投影到低维子空间里,从而抽取规律。

十二、线性代数不是一把锤子,而是一种世界观

最后想说的是,不要把数学简单理解成“冷冰冰的工具”。

真正掌握了高级数学工具的人,通常不会只把它看成一把扳手或者一把锤子。

线性代数更像是一种看待世界的高维世界观。

掌握了线性代数,就从初等数学里的单变量思维,跨越到了多变量并发的系统思维。以后当面对复杂的业务逻辑、海量的数据报表,甚至复杂的人际网络时,都会更自然地去做抽象:

- 把系统理解为变量与变量之间的耦合关系;

- 把复杂问题理解为向量与矩阵之间的作用;

- 去寻找一个复杂系统中的主方向、关键矛盾和演化趋势。

这是一种真正意义上的“降维打击”式思考能力。

大学里最可惜的事之一,就是很多很有悟性的学生,被枯燥脱节的应试教材磨灭了对硬核技术的兴趣,过早放弃了对底层逻辑的探索。

但如果已经开始追问“线性代数究竟是为了解决什么问题而生的”,那其实说明我们还没有被机械训练彻底驯化。仍然在试图追问本质,仍然保留着对根本规律的好奇心。

请把这种求知欲保留下去。

跨过算术计算的泥潭之后,我们会发现,线性代数真正训练的,不只是解题能力,而是一种理解复杂世界的能力。